Über Nacht zum Lieferkettenrisiko: Was der Anthropic-Bann in den USA wirklich bedeutet

Bislang war Anthropic einer der großen Player in Sachen KI und für viele Anwender und Unternehmen ein wertvolles Tool, besonders stark auch bei Programmieraufgaben. Claude halt. Diese Woche ist Anthropic ein Beispiel dafür, wie schnell ein KI-Stack von „läuft stabil“ zu „potenzielles Lieferkettenrisiko“ wird.

Die US-Regierung hat angeordnet, dass Bundesbehörden Anthropic-Technologie nicht mehr nutzen sollen. Gleichzeitig wurde öffentlich mit einer Einstufung als „Supply-Chain Risk“ gearbeitet, und es wurde eine Übergangsfrist kommuniziert. Anthropic kündigt an, sich juristisch zu wehren.

Man kann das als politisches Theater lesen. Man kann es auch als das lesen, was es für Unternehmen ist: ein Ereignis, das Beschaffung, Compliance und Architektur gleichzeitig berührt.

Was genau passiert ist (mehr als ein Vertragsstreit)

„I am directing EVERY Federal Agency in the United States Government to IMMEDIATELY CEASE all use of Anthropic’s technology“

Die Berichte sind in den Details unterschiedlich, aber der Kern ist konsistent:

Trump ordnete an, dass US-Bundesbehörden Anthropic-Technologie nicht weiter nutzen sollen, mit einer kommunizierten Phase-out-Frist.

Das Pentagon brachte öffentlich die Einstufung als Supply-Chain-Risiko ins Spiel.

Anthropic sagt, eine solche Einstufung sei rechtlich nicht sauber und werde angefochten.

Tech-Verbände warnen die US-Regierung vor den Kollateralschäden eines solchen Präzedenzfalls.

Selbst wenn das juristisch am Ende ganz anders ausgeht: In Unternehmen zählt nicht nur das Endurteil, sondern die Phase dazwischen. Und die ist gerade der Punkt.

Warum das ein Souveränitäts-Thema ist

Souveränität klingt schnell nach Sonntagswort. In der Praxis geht es um eine nüchterne Frage: Wie abhängig ist dein Betrieb von Entscheidungen, die außerhalb deiner Rechtsordnung fallen und sich kurzfristig ändern können. Um das sauber zu denken, hilft ein Layer-Ansatz. Genau das machen gute Arbeiten zur digitalen Souveränität: Sie zerlegen Abhängigkeit in Ebenen, statt sie als alles-oder-nichts zu behandeln.

Ich nutze dafür vier Schichten, weil sie für Unternehmen am greifbarsten sind:

1) Recht und Regulierung

Welche Regeln greifen, wenn ein Anbieter politisch unter Druck gerät. Und welche Anforderungen kommen durch Aufsicht oder Kundenanforderungen bei dir an.

Beispiel: NIS2 macht Lieferketten und Risikomanagement explizit zu einem Thema auf EU-Ebene.

Beispiel: Der EU-AI-Act definiert Pflichten für Anbieter von General-Purpose-Modellen. Auch das kann zu Marktverschiebungen führen, wenn Anbieter unterschiedliche Wege der Compliance wählen.

2) Technologie

Wie schwer kannst du überhaupt wechseln. Das ist nicht nur API-Austausch. Das sind Prompts, Auswertelogik, Tests, Sicherheitsmechanismen, Monitoring und oft auch Einbettungen/Vektordaten.

3) Kommerz und Vertrieb

Welche Kundenbeziehungen hängen an deiner Anbieterwahl. Nicht weil du reguliert bist, sondern weil deine Kunden es sind oder weil sie US-Beziehungen haben.

4) Betrieb und Geschwindigkeit

Wie schnell kannst du umstellen, ohne dass es sechs Monate Ausnahmezustand werden. Das ist der Punkt, an dem Souveränität zur Geschäftsfrage wird.

Drei Szenarien, die für deutsche Unternehmen realistisch sind

Szenario 1: Der Mittelständler, der gar nichts mit Defense zu tun hat

Du nutzt Claude intern, um Angebote zu analysieren, Prozesse zu automatisieren oder Dokumentation zu erstellen. Dein größter Kunde hat indirekte US-Public-Sector-Beziehungen, oder arbeitet mit US-Partnern, die in ihren Risiko-Fragebögen plötzlich nach „Anthropic im Stack“ fragen.

Niemand verbietet dir in Deutschland den Einsatz. Aber du bekommst ein faktisches Problem, weil dein Kunde seine Lieferkette absichert.

Szenario 2: Der regulierte Sektor

Banken und Versicherer müssen Drittparteienrisiken ernsthaft managen. DORA adressiert genau diese Richtung und spricht auch über Oversight und Anforderungen an kritische ICT-Drittanbieter.

Wenn KI in einem Prozess kritisch wird, wächst automatisch der Druck, Exit-Fähigkeit nicht nur zu dokumentieren, sondern operativ zu können.

Szenario 3: Du nutzt Anthropic nicht, aber dein Tool tut es

Das ist der häufigste Blindspot. Du kaufst ein SaaS-Tool und bekommst ein Modell mitgeliefert. Sobald ein Modell politisch unter Druck gerät, bist du trotzdem betroffen, weil du die Lieferkette deines Tools verantworten musst.

Was das für Architektur bedeutet: Multi-Modell ist ab jetzt eine Resilienz-Entscheidung

Es gibt zwei Reaktionen: Entweder man diskutiert Anbieter. Oder man baut so, dass Anbieter austauschbar sind. Wenn du aus der Anthropic-Woche eine einzige Lehre ableiten willst, dann diese: Baue so, dass du nicht überrascht wirst.

Hier ist eine kleine, realistische Checkliste, die ich in Unternehmen aktuell am sinnvollsten finde:

Abstraktionsschicht einziehen: Keine direkten Provider-SDKs in Fachanwendungen. Ein Modell-Gateway dazwischen.

Zwei-Modell-Betrieb testen: Mindestens die wichtigsten Use Cases regelmäßig gegen ein Zweitmodell laufen lassen (Qualität, Kosten, Guardrails). Definitiv auch Open Source Modelle in Erwägung ziehen.

Prompt-Portabilität messen: Nicht behaupten, dass Prompts portabel sind. Testen, dokumentieren, versionieren.

Einbettungen als Risiko behandeln: Plane die Neuberechnung ein, wenn du Vektordaten nutzt.

Lieferkette transparent machen: Welche Tools nutzen welche Modelle. Nicht nur auf dem Papier, sondern als Inventar.

Regelmäßige Wechselübung: Einmal im Quartal „Provider fällt aus“ simulieren. Nicht als Panik, sondern als Hygiene.

Das klingt nach Aufwand. Es ist aber in vielen Fällen günstiger als ein Migrationsprojekt unter Zeitdruck.

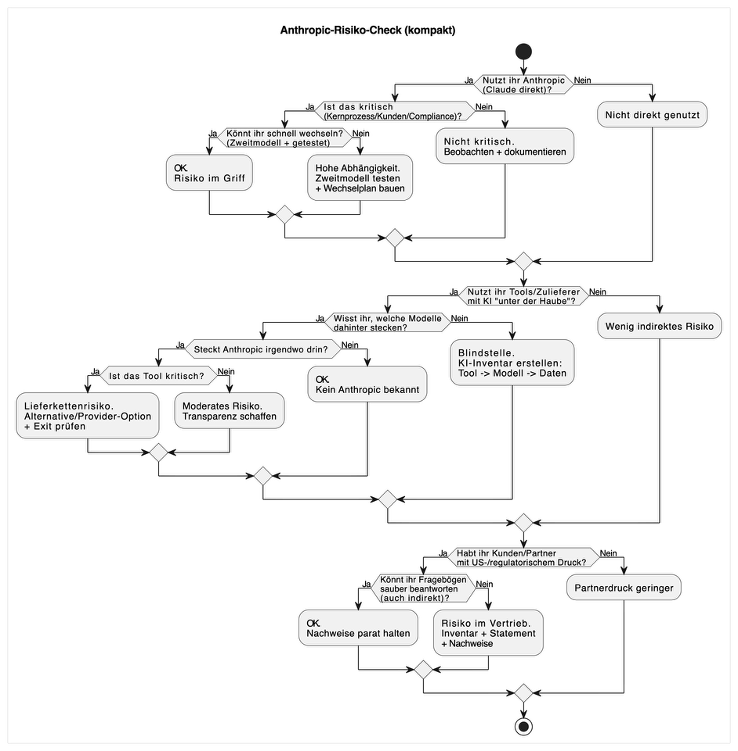

Ich habe hier noch versucht, einen Entscheidungsbaum zum Thema Anthropic zu erstellen:

Fazit

Der Anthropic-Bann ist kein Einzelfall und auch kein Anthropic-Problem. Er ist ein Signal dafür, dass KI-Anbieter inzwischen wie kritische Infrastruktur behandelt werden. Und Infrastruktur wird politisch. Wenn du KI heute produktiv nutzt, ist das keine Modellfrage mehr. Es ist eine Resilienz- und Souveränitätsfrage. Am saubersten lässt sich das mit einem Schichtenmodell betrachten, wie es EU-nahe Policy-Arbeiten und wissenschaftliche Beiträge zur digitalen Souveränität vorschlagen.

Wer jetzt Multi-Modell-Fähigkeit als echte Betriebsrealität aufbaut, kauft sich nicht nur Ausfallsicherheit. Er kauft sich Verhandlungsmacht und Ruhe.