Warum OpenAI jetzt Werbung testet und was das über das LLM-Geschäftsmodell sagt

Diese Woche ist etwas passiert, das ich als echten Wendepunkt sehe: OpenAI kündigt an, in den USA Werbung in ChatGPT zu testen. Nicht flächendeckend, aber als Experiment für Free und ChatGPT Go. Die höheren Tarife bleiben werbefrei.

Das ist mehr als „noch ein Monetarisierungshebel“. Es ist ein Signal, wie schwer es für reine LLM-Firmen ist, in der Long Run-Ökonomie profitabel zu werden, wenn man nicht gleichzeitig ein Google, Microsoft oder Amazon ist.

Und es ist auch ein Bruch mit der eigenen Erzählung.

2019 sagte Sam Altman sinngemäß: Wir haben nie Umsatz gemacht, wir haben keine Pläne für Umsatz, wir haben keine Ahnung, wie wir irgendwann Umsatz machen. Und 2024 nannte er Werbung eine Art „Last Resort“.

Jetzt sind wir hier.

Was OpenAI genau plant

OpenAI formuliert das bemerkenswert klar. In den „kommenden Wochen“ will man Werbung in den USA testen, für angemeldete Erwachsene in den Tarifen Free und Go.

Die wichtigen Details, weil genau daran sich Vertrauen entscheidet:

Anzeigen sollen Antworten nicht beeinflussen

Werbung wird getrennt und klar gekennzeichnet.Keine Weitergabe von Chat-Inhalten an Werbetreibende

OpenAI schreibt explizit, dass Unterhaltungen nicht für Werbetreibende geöffnet werden und Daten nicht verkauft werden.Kontrolle und Opt-out

Personalisierung soll abschaltbar sein, genutzte Daten löschbar.Werbeplatzierung zunächst am Ende einer Antwort

Also nicht „Banner überall“, sondern kontextnah am Ende, wenn ein gesponsertes Produkt oder eine Dienstleistung passt.

Und dazu der zweite Trigger: OpenAI pusht „ChatGPT Go“ als günstigen Tarif (8 USD/Monat) und bringt ihn jetzt auch in die USA. Das ist die Klammer: mehr Zugang über günstige Preise und über Werbung.

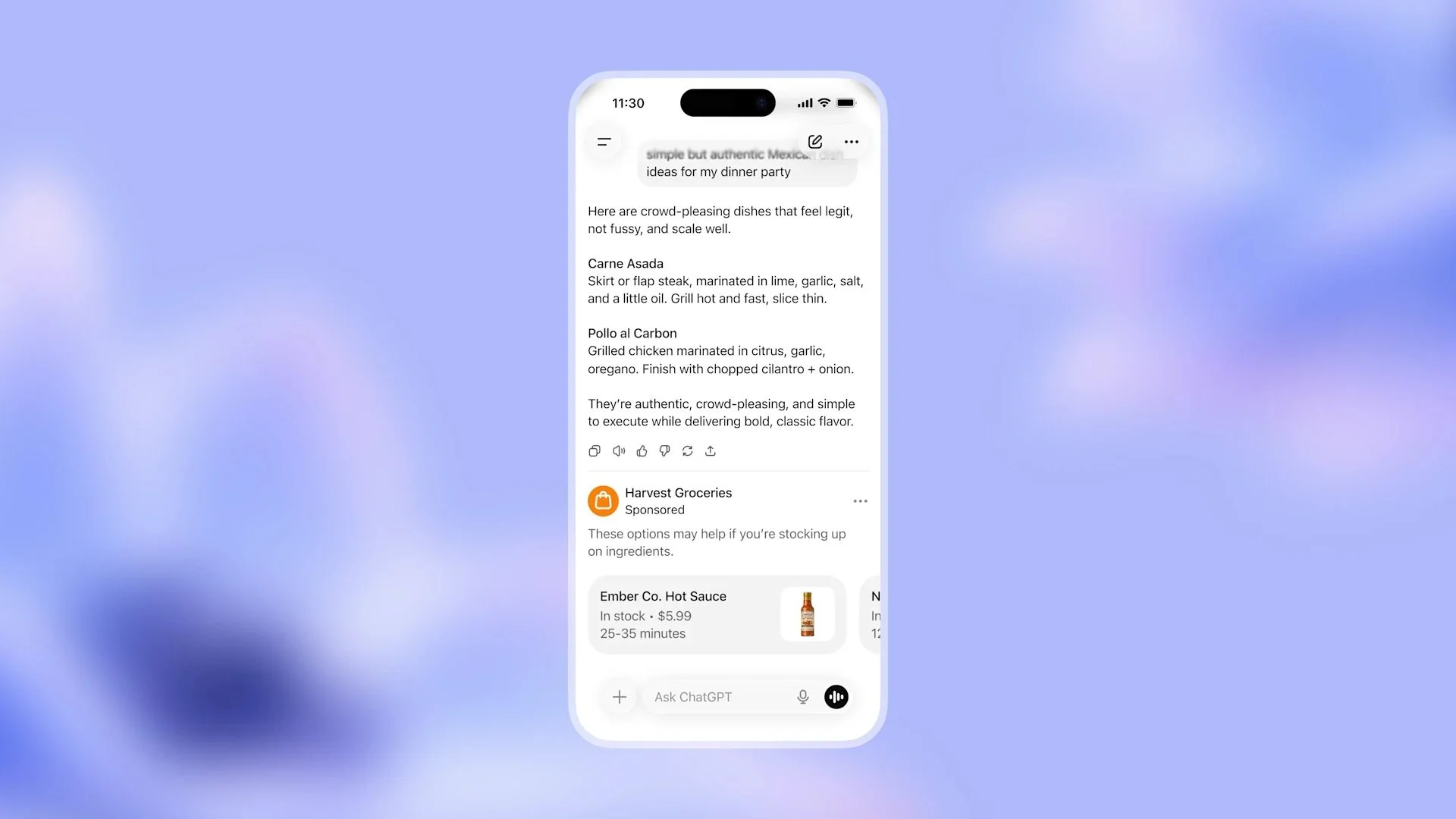

Und OpenAI zeigt im eigenen Beitrag auch, wie diese Werbung aussehen könnte:

Werbung in ChatGPT. Quelle: OpenAI

Das Grundproblem: LLMs haben eine andere Kostenkurve als klassische Software

SaaS ist schön, weil Grenzkosten (also die Kosten für jeden weiteren Nutzer bzw. jede weitere Abfrage) oft nahe null sind. LLMs sind anders:

Training kostet viel, einmalig.

Inference kostet immer wieder, pro Nutzung. Das ist insbesondere relevant für Reasoning-Modelle.

Und je erfolgreicher das Produkt, desto größer der laufende Compute-Block.

Das klingt banal, ist aber der Kern: Bei Chatbots sind die Grenzkosten nicht nur „Support und Hosting“. Es ist ein echter variabler Kostenblock, der mit Nutzung skaliert. Darum ist „nur Abos“ als Modell so attraktiv und gleichzeitig so schwierig: Du musst Preise hoch genug setzen, damit Heavy User nicht alles auffressen. Gleichzeitig willst du Masse. Werbung ist dann ein Ausweg, weil du auch bei Free-Nutzung monetarisieren kannst, ohne sofort harte Limits oder Paywalls zu ziehen.

Zahlen: Wer kann querfinanzieren und wer nicht

Hier wird der Unterschied zwischen „LLM-Firma“ und „Plattform-Konzern“ brutal sichtbar.

Microsoft und Google (Alphabet): Profitmaschinen mit eingebauter Distribution

Microsoft meldete für das Geschäftsjahr 2025 (FY25) 281,7 Mrd. USD Umsatz und 101,8 Mrd. USD Net Income.

Alphabet berichtete für 2024 350,0 Mrd. USD Umsatz und 100,1 Mrd. USD Net Income.

Diese Firmen können drei Dinge, die reine Modellanbieter kaum können:

Verluste im Geschäft mit Foundation Models über Jahre tragen.

KI in bestehende Produkte integrieren (Search, Office, Cloud) und dort monetarisieren.

Distribution „gratis“ nutzen, weil die Nutzer schon da sind.

OpenAI: starkes Wachstum, aber Geldfresser-Dynamik

OpenAI ist in privater Hand (nicht gelistet an einer Börse), daher sind Zahlen immer „reported“. Aber die Richtung ist eindeutig:

Reuters berichtete (unter Verweis auf The Information), OpenAI habe ca. 4,3 Mrd. USD Umsatz in der ersten Jahreshälfte 2025 gemacht.

Die Financial Times berichtet für das erste Halbjahr 2025 von sehr hohen Kosten und einer Operating-Loss-Zahl von 7,8 Mrd. USD.

Für 2024 kursierten Berichte über rund 3,7 Mrd. USD Umsatz bei rund 5 Mrd. USD Verlust (basierend auf Dokumenten, über die berichtet wurde).

Heißt praktisch: Selbst wenn Umsatz schnell wächst, frisst die Skalierung einen Teil der Effekte direkt wieder auf. Und das ist noch ohne die ganz großen Infrastruktur-Wetten gedacht.

Anthropic: ähnlich, nur weniger Consumer-Monetarisierung

Auch Anthropic ist privat. In der Presse war wiederholt von sehr hohen laufenden Kosten („cash burn“) die Rede, also einem Modell, das stark auf Finanzierung und Cloud-Deals angewiesen ist.

Wie können OpenAI, Anthropic und Co. langfristig Geld verdienen?

Ich sehe aktuell sechs realistische Pfade. Die meisten Firmen werden nicht „den einen“ wählen, sondern mixen.

1) Abos mit klarer Preis-Leiter

Free → günstig → Plus/Pro → Business/Enterprise. Genau das baut OpenAI gerade aus, inklusive Go als Preisschild für den Massenmarkt.

Entscheidend wird: Preis nach Wert, nicht nach „Tokens“. Der Normalnutzer zahlt für Komfort, Speicher, Multimodalität, Geschwindigkeit, Agenten-Funktionen.

2) Usage-Based APIs und Enterprise-Verträge

Das ist der „klassische“ Weg. Funktioniert gut, wenn ein Unternehmen echte Workflows baut. Problem: Margen hängen stark davon ab, wie gut man Inference-Kosten optimiert.

3) Plattform-Take-Rates

Marketplace-Modelle: Tools, Agents, Plugins, vertikale Skills. Wenn Drittanbieter Umsatz machen, nimmt die Plattform einen Cut. Das skaliert besser als reine Token-Abrechnung, weil Wertschöpfung höher ist.

4) Bundling mit Cloud und Software

Hier sind Microsoft und Google im Vorteil. Für sie ist KI oft ein Feature, das Nachfrage in Azure/GCP oder in Office/Workspace schiebt. Reine Modellfirmen können das nur über Partnerschaften abbilden.

5) Lizenzierung und Embedded Deals

Search-Integration, Device-Deals, OEM-Partnerschaften, Enterprise-White-Label. Gut für planbare Umsätze, aber oft mit Abhängigkeiten.

6) Werbung, aber anders als klassische Display-Ads

Das ist der eigentliche Gamechanger. Wenn eine Oberfläche Fragen beantwortet („Was soll ich kaufen?“, „Welche Software passt?“), dann ist Werbung nicht nur „Unterbrechung“, sondern kann als „gesponserte Option“ daherkommen.

OpenAI beschreibt genau diese Richtung: kontextnah, am Ende der Antwort, als gesponsertes Produkt oder Service. Das ist näher an Google-Search-Ads als an Social-Feeds. Nur mit einem Twist: Der Chat kennt den Kontext besser. Und bei Google-Suchen haben wir uns auch an die eingeblendete Werbung gewöhnt und diese angenommen.

Warum Werbung ausgerechnet hier so verlockend ist

Altman hat nicht ohne Grund gesagt, Ads plus AI seien „uniquely unsettling“ und Werbung sei ein „Last Resort“. Denn sobald Monetarisierung an Gesprächskontext hängt, entstehen drei Spannungen:

Trust vs. Monetarisierung

Sobald Nutzer denken, Antworten seien „biased“, ist das Produkt beschädigt.Privacy vs. Targeting

OpenAI sagt: keine Weitergabe von Chats, keine Datenverkäufe, Personalisierung optional.

Das ist die richtige Richtung. Aber der Druck, „bessere“ Ads zu liefern, steigt mit den Umsatzzielen.Neutralität vs. Commerce-Layer

Wenn der Chat zum Einkaufsberater wird, wird er auch zum Gatekeeper. Das ist ein neues Machtzentrum.

Was das für KMU bedeutet

Drei konkrete Implikationen, die ich für ambros.digital-Kunden sofort auf dem Zettel hätte:

„ChatGPT SEO/AEO“ wird real

Wenn Ads am Ende von Antworten auftauchen, wird Sichtbarkeit in LLM-Oberflächen ein neues Feld. Produktdaten, klare Positionierung, Reviews, strukturierte Informationen werden wichtiger, weil die Systeme irgendwoher ihre „Optionen“ ziehen müssen.Performance Marketing verschiebt sich Richtung Intent

Werbung in einem Chat ist näher an „Problem gelöst bekommen“ als an „aufmerksamkeitsbasiert scrollen“. Wer Angebote hat, die sich gut als nächster Schritt anbieten, gewinnt.Eigene Assistenz-Oberflächen werden attraktiver

Wenn du nicht willst, dass deine Kundenbeziehung durch fremde Ads „unterbrochen“ wird, lohnt es sich, eigene KI-Assistenz im Support, im Vertrieb oder in Portalen aufzubauen. Dann kontrollierst du Experience und Monetarisierung selbst.

Fazit

Werbung in ChatGPT ist nicht einfach ein neues Feature. Es ist ein Hinweis, wie die Branche erwachsen wird:

LLM-Firmen brauchen mehr als Subscriptions und APIs, weil die Kostenstruktur gnadenlos ist.

Big Tech kann KI querfinanzieren und über bestehende Cashcows monetarisieren.

Reine Modellanbieter müssen ihr Geschäftsmodell diversifizieren. Werbung ist dabei die mächtigste, aber auch die riskanteste Option.

Wenn OpenAI das sauber hinbekommt, kann das den „Free-Zugang“ langfristig stabilisieren. Wenn nicht, wird es ein Vertrauens-Bumerang.